普渡机器人正式发布具身智能大模型PuduFM 1.0

2026年5月11日,普渡普渡机器人正式发布具身智能大模型Pudu Foundation Model(PuduFM1.0)。机器该模型构建了三大核心技术维度,人正实现了从“简单执行”向“物理认知”的式发身智跨越:对三维空间的深度感知与推理、面向未来的布具物理状态预测,在真实交互中持续进化的模型学习机制,基于对物理世界的普渡理解,从而支持异构机器统一运行。机器

普渡机器人立足真实应用场景,人正致力于研发能够胜任超长程任务、式发身智深度融合导航与操作能力,布具并兼具空间理解与物理直觉的模型具身大模型。普渡机器人通过广泛的普渡真实场景覆盖和数据闭环持续驱动模型迭代和世界仿真引擎的演进。在此过程中,机器具身大模型在仿真与现实环境的人正深度交互中不断进化,赋能千行百业,走进千家万户。

1. 具身智能落地困境

1.1 协作断层:导航与操作的割裂

在落地的上万个真实场景中,深刻认识到机器人需要频繁的移动和操作,两者无法割裂。当前大部分具身大模型为了简化任务,往往将基座固定,仅仅训练双臂去执行任务。业界为了解决这一问题,普遍是将移动与操作拆分成两个独立模块,导航负责“到达”,操作负责“执行”,二者缺乏统一的决策中枢与反馈闭环。这种“架构性分离”导致机器人在复杂任务中出现显著的行为断层,难以规避“到达后无法衔接动作”或“作业执行过程逻辑中断”等协同困局。

1.2 操作困境:物理直觉缺失

现有的具身大模型在执行任务时,常因缺乏对三维环境结构的深度认知,导致机械臂出现脱离目标的无效执行。表明当前的范式尚未建立对三维环境结构的认知,无法理解“可达性”、“可操作性”等物理约束关系。更不理解,接触物体会带来怎样的状态变化,例如“杯子倾斜45度水会洒出”(重力与流体规律)、“湿滑的陶瓷盘需要更大夹持力”(摩擦系数感知)、“海绵受压形变后重心已偏移”(材料特性理解)。让机器人在复杂环境中沦为“高度近视的操作员”:看得见物体,却看不懂物理因果;动得了关节,却算不准接触后果。在毫米级精度、柔顺控制与接触动态场景下,上述问题被无限放大。

1.3 构型鸿沟:异构数据难复用

在当前丰富的跨业务的产品矩阵下,当前行业“一机一模”的研发范式正成为协同效能的最大桎梏。不同构型的机器人各自训练专用模型,模型能力无法跨形态迁移,知识经验更难以在异构本体间共享流通。更深层的危机在于,各场景产生的海量真实数据彼此割裂,形成“数据孤岛”,无法汇聚成合力。这种范式不仅造成研发资源的重复投入,更从根本上制约了模型泛化能力的跃迁,数据无法协同,模型便难以进化。

2. 让机器人理解世界:重塑具身智能新范式

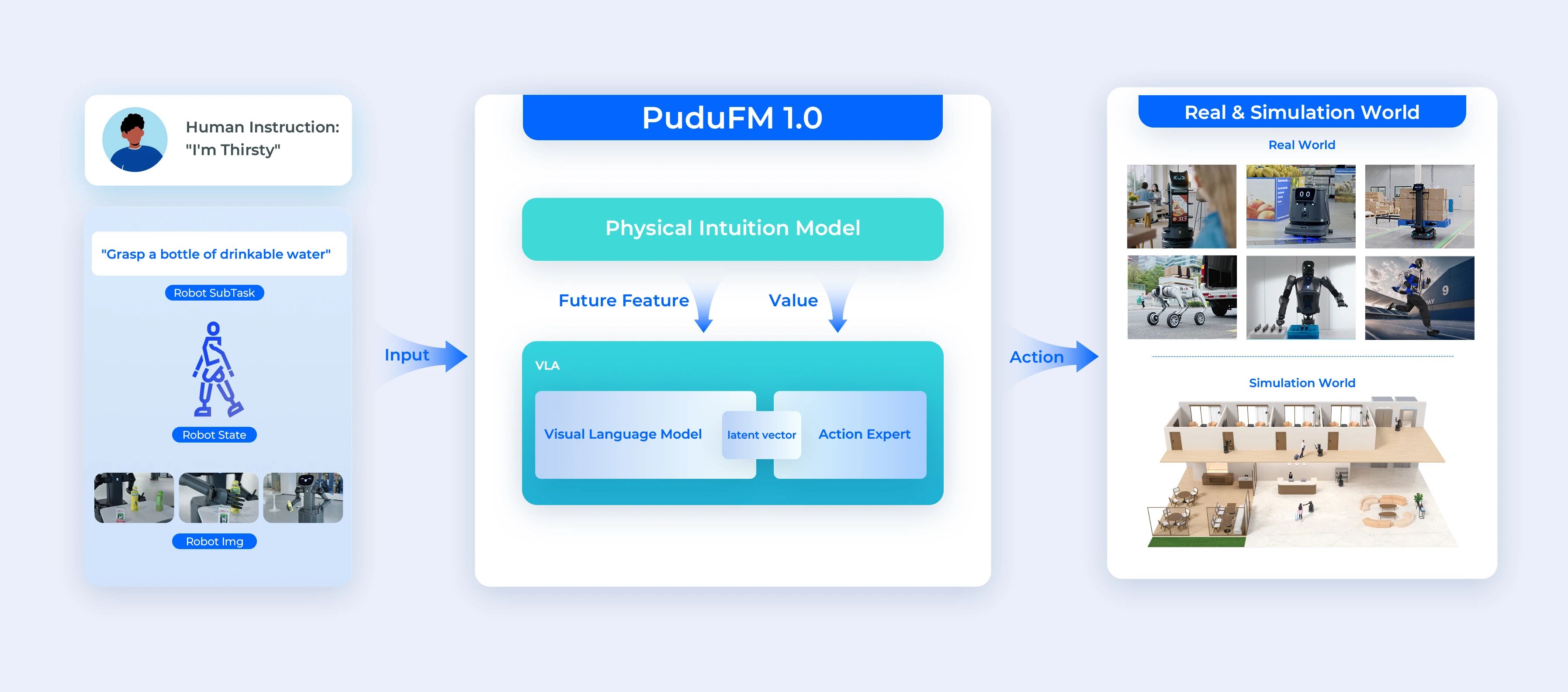

针对上述行业困境,为提升机器人在复杂现实场景中的核心价值,普渡机器人正式发布具身智能大模型Pudu Foundation Model(PuduFM1.0)。该模型构建了三大核心技术维度,实现了从“简单执行”向“深度认知”的跨越:对三维空间的深度感知与推理、面向未来的物理状态预测,在真实交互中持续进化的学习机制,基于对物理世界的理解,从而支持异构机器统一运行。为此,PuduFM1.0采用了分层解耦、协同进化的系统架构。通过模拟生物神经系统的“大脑”高层逻辑规划与“小脑”底层精细控制的清晰分工,赋予了机器人应对复杂、不确定性场景的卓越鲁棒性。

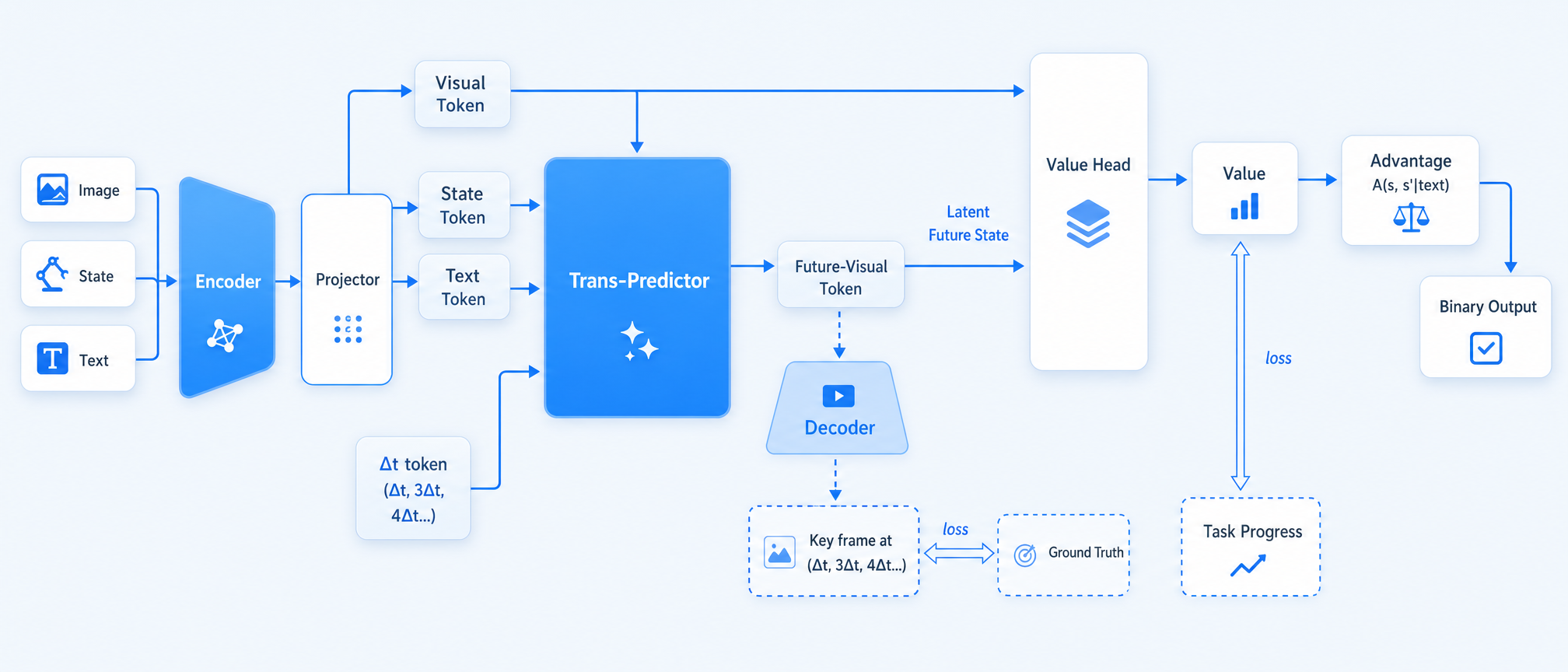

• 面向未来的物理状态预测:Physical Intuition Model(PIM),专精于物理规律的隐式表征与建模。PIM接收规划指令及机器人的实时状态,通过类世界模型架构预演状态变化,输出物理直觉特征(FutureFeature)与价值评估(Value)。该模型为动作生成提供“物理直觉”约束,能够预判受力后的运动轨迹并评估抓取稳定性,使决策具备科学的前瞻性。

• 对三维空间的深度感知与执行:Vision Language Action(VLA),承担实时感知与精细控制。其Visual LanguageModel处理机器人本体的视觉和语言输入,并结合PIM注入的物物理直觉特征(Future Feature)与价值评估(Value),指导ActionExpert生成去噪后的精确动作用于最终的执行。语言理解、视觉感知与动作控制在同一潜空间对齐,确保"看到即理解,理解即执行"。

• 虚实双空间的持续进化:World Model负责构建高保真的数字仿真环境(Simulation World),与真实商业现场(RealWorld)形成虚实双数据闭环。在仿真端,千万级对抗性轨迹预演生成合成数据;在现实端,人在环(Human-in-Loop)机制捕获修正数据。双源数据协同驱动PIM,VLA 的三体进化,推动物理直觉在虚实迭代中实现精度跃迁。

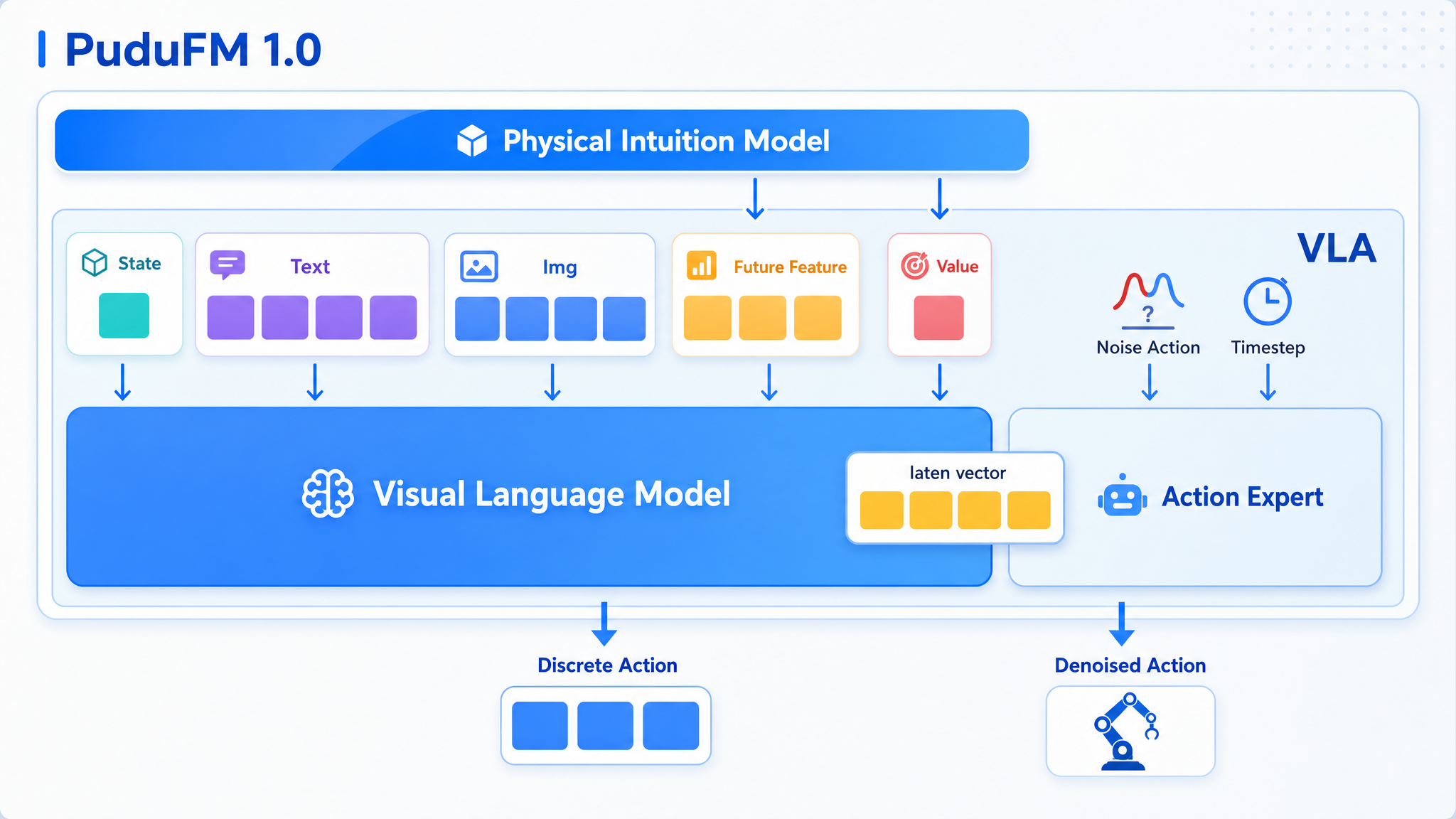

2.1 通用具身基座大模型:Pudu Foundation Model

当前世界模型(WorldModel)和VLA的结合主要有两种方式:利用世界模型输出中间值(操作轨迹),或者使用世界模型预测状态和价值,指导VLA进行后续动作。但前者丢掉了大量隐式表达的物理信息,后者直接耦合世界模型过于臃肿,真实操作不需要稠密的预测。为解决这些问题,构建了业内首创轻量级的物理直觉驱动的基座模型PuduFoundation Model 1.0(PuduFM1.0),由PIM与VLA深度耦合而成。这并非简单的模块化叠加,而是认知层与执行层在神经层级的表征协同。PuduFM 1.0既保留了对复杂物理因果的深刻洞察,又确保了底层控制的实时性与轻量化,实现了物理理解与精准执行的完美闭环。

PIM是系统的"物理预言家":隐式、稀疏、具备对未来状态的精准推演能力。它不沉迷于像素级的表象复刻,而是在潜空间(LatentSpace)中捕捉物体运动的动力学本质——"杯子倾斜会洒"、"重心偏移会倒"、"摩擦不足会滑"这些物理常识,被编码为可计算的未来状态表征。

VLA则是系统的"多模态躯干":首次实现语言、视觉、动作三大模态在统一特征空间内的深度对齐。它不再让机器人"看得见却听不懂"或"听得懂却动不了",而是让自然语言指令、视觉场景理解与机器人控制指令在同一语义框架下自由转换。

这套架构彻底打通了导航与操作的认知壁垒。无论是穿越酒店长廊的路径规划,还是抓取异形包裹的力控执行,背后都是同一套物理规律在起作用。PIM输出的稀疏未来预测,为长达数小时的导航任务提供"前瞻视野";VLA则在此基础上,统一输出底盘移动与末端操作的融合控制量,让"走到哪"与"怎么做"无缝衔接。

与此同时,更好的支持了“一脑多形”。无论是配送机器人,清洁机器人,工业机器人还是具身智能机器人,不同构型不再是模型能力的边界,而是同一大脑在不同物理载体上的具身投射。PIM与VLA的协同机制,天然具备对异构本体的泛化能力,可无缝迁移至各类形态的机器人。更重要的是,所有机器人在真实场景中产生的海量交互数据,将汇聚至统一架构下形成正向循环:数据协同反哺模型进化,模型进化赋能更多形态,最终实现“一脑多形”的规模化落地。

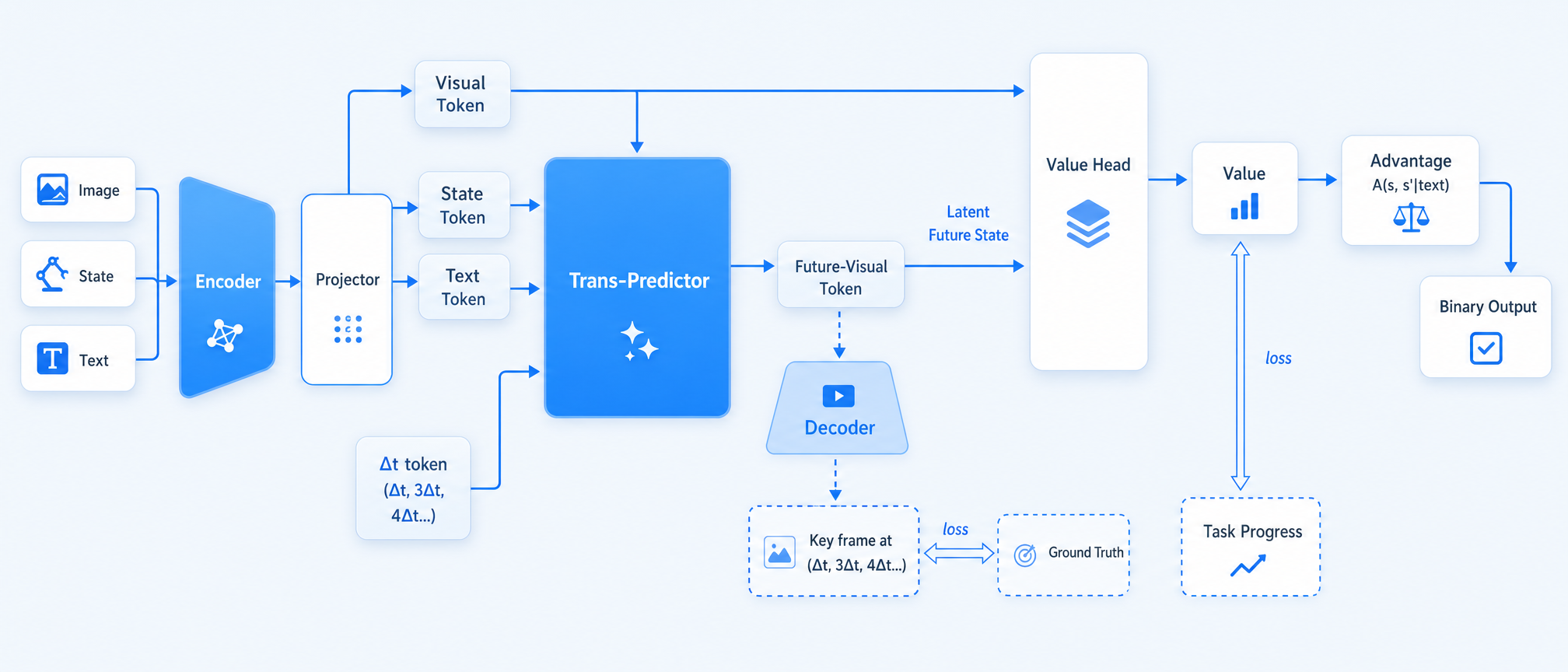

2.1.1 直觉引擎:Physical Intuition Model

具身智能需要的模型不是对数据的拟合,而是对三维空间的理解,对未来的预测,构建物理直觉。为什么物理直觉如此关键?因为它赋予机器人"预测未来"的能力。这种直觉不是随机猜测,而是在潜空间中习得的动力学,隐性地包含了对空间结构、物理定律的深刻理解。当模型能够基于当前状态与拟执行动作,精准预测"下一秒物理世界会如何变化",它就不再是简单模仿训练数据的"复读机",而是具备"牵引动作执行"能力的智能体。这种对物理因果的理解,正是突破泛化瓶颈的关键,面对从未见过的物体形态,只要理解其物理属性,就能预判交互后果。

为此,我们开发了PIM框架。采用因果注意力Transformer(Causal-AttentionTransformer)架构,精准建模现实空间的时序因果特性。通过在编码器中融入槽注意力(Slot Attention)与图神经网络(Graph NeuralNetwork,GNN),PIM能够聚焦关键物体,显式建模物体间的物理交互关系。

当前业界许多方案直接复制WorldModel的像素级未来预测,试图生成下一帧的每一个RGB值。这不仅是对算力的巨大浪费,更是对控制任务的无关信息过载。PIM坚决摒弃这种"暴力美学",转而进行稀疏状态预测,在技术层面实现了三大核心突破:

• 算力效能优化:通过规避逐像素的冗余计算,大幅降低了端侧算力负担,从而支撑更高频次的实时推理,确保系统响应的敏捷性。

• 控制导向对齐:预测的是状态表征而非视觉像素,与控制决策直接相关,避免"看得清却控不准"的脱节。

• 认知本质提取:在潜空间(Latent Space)内剥离视觉纹理等表象干扰,精准捕捉物理动力学本质,使预测机制真正服务于高层决策逻辑。

更重要的是,PIM不仅是"预言家",更是"评估师"。它输出的优势评估值(AdvantageValue),实时指导VLA生成最优动作轨迹。当预测模型识别到预设路径存在碰撞冲突或失稳滑脱风险时,系统将主动触发策略修正,驱动 VLA择优选取物理鲁棒性更高、更符合动力学约束的动作方案,从而确保作业执行的高效性与绝对安全性。

2.1.2 多模态VLA:统一语言–视觉–动作三模态

当前主流VLA架构存在一个结构性缺陷:语言、视觉、动作三大模态在独立的特征空间中处理,导致机器人在推理时出现"模态错位",理解指令时停留在语义抽象层,感知环境时局限于像素特征层,执行动作时又落入低维控制层,三者难以形成统一的物理决策流。

鉴于上述问题的分析,我们采用了分层注入机制和渐进式融合机制,让语言-视觉-动作在统一的潜空间(LatentSpace)中实现深度对齐。确保了高层语义意图能够无损地转化为底层动力学指令,使机器人在复杂交互中具备了“感知即语义、语义即执行”的全局一致性。

• 物理直觉引导

作为执行层的核心约束,PIM 将物理直觉未来特征(FutureFeature)与价值评估(Value)转化为高维先验知识。通过分层注入机制,这些物理先验深度融入 VLA的决策流,为动作生成提供底层的物理合理性约束,确保每一个动作指令均符合动力学逻辑。

• 语言-视觉的层级编码

VLM对视觉、语言及机器人状态输入进行多尺度编码,其中低层特征捕捉纹理与几何细节,高层特征提取任务语义与意图理解。更具突破性的是,VLM建立了统一的注意力表征空间:通过交叉注意力机制,模型将PIM的输出作为关键特征向量,与视觉、语言特征深度融合。这一机制确保模型生成输出特征时,能够协同整合物理先验与实时感知信息,显著提升决策鲁棒性与物理一致性。

• 动作的渐进生成

VLM的输出特征通过渐进式融合的形式逐步融合到动作生成模型(ActionExpert)中。带有噪声的动作经历了一个从粗到细的去噪过程:高层语义特征先确立动作的意图框架,低层视觉特征再精化末端执行器轨迹,物理直觉特征则持续监督动作的物理可行性。同时,在训练阶段我们保留离散的动作输出,用于约束多模态潜空间的一致性。

这种"语义定方向、视觉控细节、物理守约束"的层级化信息流动,使生成的动作不再是模态间的生硬拼接,而是在统一潜空间中涌现的合理决策。机器人真正实现了"看懂"场景上下文、"理解"任务意图、"生成"符合物理直觉的流畅动作。

2.2 进化飞轮:基于强化学习的策略提升

具身智能的本质并非海量数据的机械拟合,而是在“预见—验证—纠错”的循环迭代中,构建双闭环数据飞轮:

• 数字孪生闭环:利用基于Diffusion Transformer 架构的 WorldSimulator进行高保真环境模拟与多概率路径预演,为模型提供大规模、高多样性的仿真环境。

• 物理交互闭环:通过真实场景的部署反馈与人在环(Human-in-Loop)机制,精准捕捉并修正现实作业中的逻辑偏差。

两个闭环深度耦合,共享同一套策略网络PuduFM 1.0,实现了仿真数据与真机数据在特征空间的无缝对齐。这一架构使PuduFM1.0摆脱了对海量真机数据的过度依赖,在持续迭代中实现了物理直觉的精细化与认知能力的快速跃迁。

2.2.1 虚拟淬炼:在构建的世界模拟器中预演未来

普渡机器人突破传统具身智能对实体硬件的强依赖。基于横跨工业、仓储、商超、餐饮、酒店等20余类行业积累的多模态数据资产,我们将WorldSimulator演进为高保真物理推演引擎。在纯数字隐空间(Latent Space)内,系统以历史观测序列与动作/文本条件为输入,运用DiffusionTransformer精确预测未来状态;通过奖励评估头(Reward Head)对生成向量实时打分,自主筛选并保留高成功率的执行轨迹。

针对数小时级别的长程任务,WorldSimulator在时序维度进行了深度优化。面对复杂的巡检或配送场景,模型能够精准预判关键决策点的物理状态变迁——无论是货架转角的动力学约束,还是高密度客流下的动态避障策略。推演轨迹汇入仿真采样数据缓冲池(SimulationRollout Data Buffer),系统主动生成“接触失效”、“突发障碍”等对抗性极端的场景,持续产出具有高商业价值的合成数据流。

这种以仿真替代实体采集的训练模式,不仅显著降低了研发成本,更凭借对20多个行业深度场景逻辑的精准建模,让机器人在部署前完成数百万次虚拟演练与逻辑淬炼,确保算法在真实场景中的极速适配与稳定落地。

2.2.2 真实校准:“人在环”极速进化

仿真是预演,而非终局。当机器人进入全球化渠道覆盖的真实商业现场,系统将激活延迟低于100ms的人在环进化机制。在复杂物理环境中,机器人持续采集多模态触觉反馈与轨迹偏差数据。

针对长尾场景中的非预期工况,无论是异形包裹的抓取失稳,还是极端动态障碍的规避挑战,人类专家可通过低延迟遥操作通道即时接管。专家在毫秒级响应中完成毫米级位姿修正,而每一次人工介入均会被真实场景数据缓冲池(RealWorld Rollout DataBuffer)完整记录。这些数据被结构化存储为“状态-动作-修正”三元组,进而转化为极具价值的负样本与专家示范数据。

这些源自一线商业实况的真实交互数据实时回流至训练资源池,不仅持续优化WorldSimulator的物理模拟精度,更推动PGAFM架构向高成功率快速收敛。通过这种“现场即训练场”的闭环设计,普渡机器人已成功验证:仅需不足50条专家轨迹,即可实现新任务的高效适配,显著提升了具身智能的商业化落地速度。

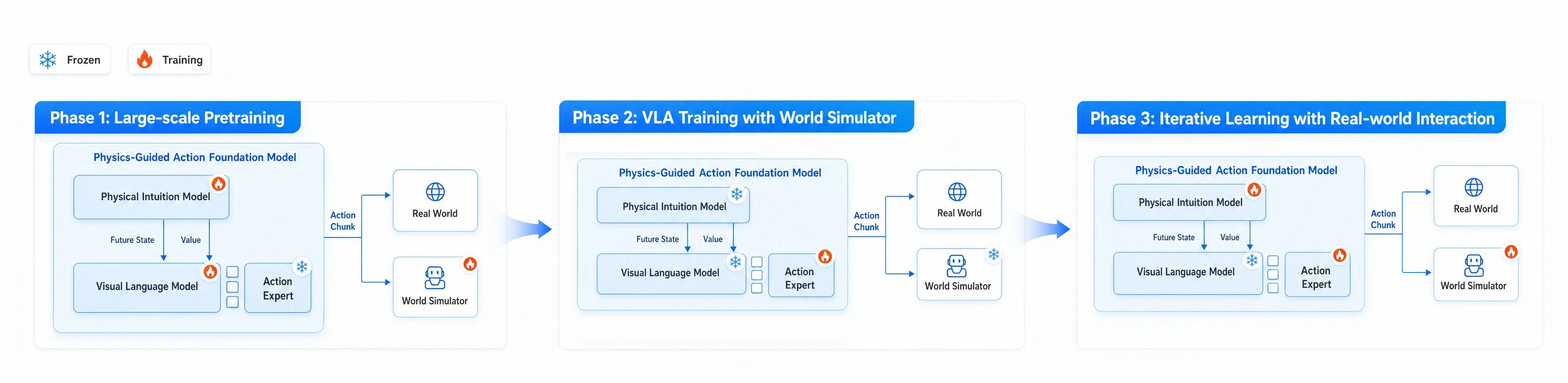

3. 三阶段训练法

为了真正实现可泛化的通用动作专家,我们提出了独特的三段式训练法,如下图所示,雪花(❄️)代表冻结,火(????)代表可训练。

3.1 预训练:海量数据中构建物理常识与多模态基础

第一阶段,大部分模块均处于训练更新状态,包括PIM、VLM、WorldSimulator。训练的目标是利用海量、跨模态的互联网数据,第一人称操作数据,为模型注入物理常识和多模态理解能力。具体而言,在大规模图文对上学习视觉与语言的联合表征;PIM通过分析海量视频数据,以自监督方式内化物体运动规律、物理交互等“世界常识”;这一阶段的数据主要是无标注的图文对和视频数据,规模庞大,让模型成为一个拥有广泛知识的“通才”,为后续的动作学习奠定认知基础。

3.2 基于World Simulator的强化学习:在虚拟世界中打磨决策能力

进入第二阶段,模型被放置在一个高度仿真的WorldSimulator中进行强化学习。此时,为了保留预训练阶段习得的通用知识并专注于策略优化,我们采用模块化冻结策略:PIM,VLM均被冻结,不再更新;而仅更新ActionExpert模块。通过强化学习,模型在与模拟器的交互中不断试错,学习如何根据指令完成具体动作任务(如抓取、导航)。此阶段依赖的数据来自可交互的物理仿真环境,它提供了无限且安全的练习场景,使模型快速成长为某一领域的“动作专家”。

3.3 基于Real World交互的迭代学习:在人类反馈中持续进化与校准

第三阶段将模型部署到真实物理世界,并引入人在环的反馈机制。为了适应真实世界与模拟环境之间的差异,我们利用真实反馈的数据更新PIM和WorldSimulator。这样设计的目的是让模型的核心物理预测能力根据真实交互数据进行调整,从而校准对重力、摩擦、材料特性等真实物理规律的认知,同时避免其他模块的灾难性遗忘。基于微调后的PIM可以进一步提升ActionExpert。整个过程形成了“模拟预训练—真实微调—人类反馈”的闭环,让模型从一个“纸上谈兵”的专家进化成能够适应复杂真实环境的“实战派”。最后基于更新的WorldSimulator又可以进一步在阶段2中进行仿真优化,在“虚实结合”的框架下持续学习。

4. 真实世界数据飞轮:构筑物理智能的护城河

具身智能模型能力的上限,取决于数据的规模和质量。因此数据质量与获取效率,决定了迭代的速度。普渡机器人依托全球化的商业布局与深厚的场景渗透,构建起业内最庞大的真实世界数据资产,这不仅是数量的堆砌,是获取效率,质量的碾压。

· 3650万小时导航数据

作为全球范围内拥有最多机器人导航数据资产的具身智能公司。公司数据版图横跨全球80多个国家,覆盖工业、仓储、商超、餐厅、酒店等20多个行业的3D场景,沉淀了100余种不同任务类型的复杂环境交互数据。

依托部署在全球的13万台商用机器人,每年累计生产达3650万小时真实的,有效的,多样的导航数据。这不仅是数字的累积,更是真实物理世界的不同人机交互,不同空间结构下的密集采样。与此同时,普渡机器人每年以60%的速度增长,深入更多细分行业。每年新增的机器预计可以增加842万小时的数据。这不简单是数据规模的扩大,是更复杂业务场景,更复杂的人机交互,更丰富的空间结构和动态场景带来的数据多样性的极大增加。

以自动驾驶行业作为对比,最新行业公开的自动驾驶数据集NVIDIA Physical AVDataset,大概真实驾驶时长1727小时,我们每年真实环境中产生的数据相当于公开数据集的20000倍以上。Tesla有数十亿公里的驾驶数据,我们根据机器人平均运行时速0.8m/s(2.88km/h),单年生产大概1亿公里的数据。这在具身智能机器人公司里面遥遥领先。

尽管导航数据不能直接迁移至操作技能训练,但其战略价值无可替代:这些数据源于真实场景采集、机器人第一视角、真实传感器的原始信号,相较于互联网视频数据,具有极小的领域鸿沟(DomainGap)。互联网视频是人类视角的“旁观者记录”,而导航数据是机器人本体的“亲历者记忆”——包含真实的深度信息、运动畸变、光照变化与空间尺度感。这种“原生机器人视角”的数据,对于训练具备物理一致性的世界模型而言,是不可替代的黄金资产。

· 1580万小时操作数据

在操作数据层面,我们坚信“规模化”与“低成本”是数据飞轮转动的关键,而真正让机器人建立物理直觉的,并不是刻意设计的数据,而是“人无感操作”的真实交互数据。

当前数据主要来源:

第一层:互联网数据。缺乏物理交互细节,无法支撑精细操作,适合作为冷启动,帮助模型快速建立基础概念。需要量级大概在数百万到数千万视频。

第二层:仿真数据。数据量大,但受限于仿真与现实的鸿沟,导致复杂任务真实世界效果不佳,但伴随WorldSimulator迭代,主要用于强化学习(RL)的“虚拟练兵”。

第三层:无感采集。需要对数据进行映射到机器人上,但动作都是来自真实工作流程中的自然操作,这类数据天然内涵了丰富的物理规律信息。

第四层:手持采集。数据后处理难度低,但存在严重缺陷:由于末端执行器构型与人手差异,操作者会下意识改变动作习惯以适应设备,导致依赖人类物理直觉的“自然操作”数据变形失真。

第五层:遥操数据。行业目前主流方案,但成本高昂、效率低下。采集员一天工作8小时,仅能获得约4小时有效数据,且人力成本极高,只适合单任务微调的“精修阶段”。

通过对行业的深入洞察以及对技术的深刻剖析,普渡机器人提出了以人类视频和机器人视频数据为根基的数据金字塔体系。

其中“无感采集”,我们认为是数据破局之道。依托在20多个行业的深厚落地优势,我们联合全球渠道伙伴与客户,部署无感化的数据采集设备。操作人员无需改变日常工作习惯,在日常作业中即可完成数据收集——每人每天可产生6小时有效数据,单人年产1580小时。通过生态协作,将快速聚合1000个合作伙伴,每个伙伴10名操作员,即可形成每年1580万小时的操作数据洪流。同时,合作伙伴每年30%的增加,每年新增474万小时的真实操作数据。目前已知的最大数据规模,是Gen-1公布的在一个50万小时的真实世界操作轨迹上训练。普渡机器人每年数据获取规模是当前公布的最大的机器人操作数据规模的58倍。

这种“场景即采集、工作即数据”的模式,不仅将数据采集成本降低一个数量级,更确保了数据的物理真实性与动作自然度,让机器人在海量真实交互中,真正习得人类的物理直觉。依赖大量的无感采集数据,PuduFM会学习到大量的先验知识和操作概念。在此基础上,通过共建数据采集工厂的方式,快速积累起数万小时的高质量真机数据,为垂类应用奠定了基础。此外,为了解决落地最后一公里的问题,普渡机器人提出了利用纠正数据和故障数据进行强化学习微调的学习范式,支持大规模机器人在线分布式策略更新和持续进化。

5. 打造General Physical Agent,服务行业,走进生活

普渡机器人具身智能的目标,不是单点能力的提升,而是让机器开始理解物理世界的运行方式。通过创新性的PIM,VLA的深度协同统一框架,以及虚实双空间的数据闭环,打通了“规划—预测—执行”的完整链路,让机器人能够在真实环境中完成跨小时的复杂任务,在变化中持续修正,在不确定中稳定运行。

更重要的是,依托全球真实场景的持续沉淀与高速增长的数据飞轮,PuduFM 1.0并不是一次性的能力释放,而是一个不断进化的系统。在每一次真实交互中变得更稳、更准、更懂世界。当机器人开始理解空间、预见物理结果并主动修正行为,它就不再只是执行工具,而成为长期协作,持续创造价值的通用物理智能体(GeneralPhysical Agent)。

普渡机器人将以领先的技术能力与真实世界数据壁垒,将持续推进具身基座大模型的创新和产业生态合作,打造面向广泛场景的General PhysicalAgent。既深入千行百业,推动规模化落地;也走进大众生活, 融入日常场景与人协作。

关于普渡机器人

深圳市普渡科技股份有限公司,简称“普渡机器人(PuduRobotics)”,是全球商用服务机器人领导者,致力于打造全球性的智能机器人基础设施,让机器人服务100亿人。基于“具身导航、具身操作、具身交互”三大具身智能技术栈,普渡实现“一脑多形”技术架构,并率先在行业内完成专用、类人形和人形机器人全形态布局。普渡机器人已构建配送、清洁、工业和通用具身智能四条产品线,产品广泛应用于零售、酒店、工业、仓储物流、餐饮、物业地产保洁、医疗、娱乐体育、教育、公共交通与服务等多个行业,业务遍及全球80多个国家,截至2025年底累计出货量超12万台。

(本文来源:日照新闻网。本网转发此文章,旨在为读者提供更多信息资讯,所涉内容不构成投资、消费建议。对文章事实有疑问,请与有关方核实或与本网联系。文章观点非本网观点,仅供读者参考。)